大语言模型(LLMs)在多个领域展现出卓越性能,但其高昂的推理延迟日益成为瓶颈。为了加速推理,早期退出(Early Exit)方案应运而生,它通过动态跳过模型中冗余的计算层,以期提升效率。

然而,在仅解码器(decoder-only)架构中,早期退出的效率受到“KV缓存缺失”(KV Cache Absence)问题的严重制约。这意味着当某些层被跳过时,它们无法为后续生成的token提供必要的历史状态(即KV缓存),导致信息断裂。现有的解决方案,例如重新计算或掩码处理,要么引入显著的延迟开销,要么导致严重的精度损失,未能有效弥合理论层数减少与实际运行时间加速之间的差距。

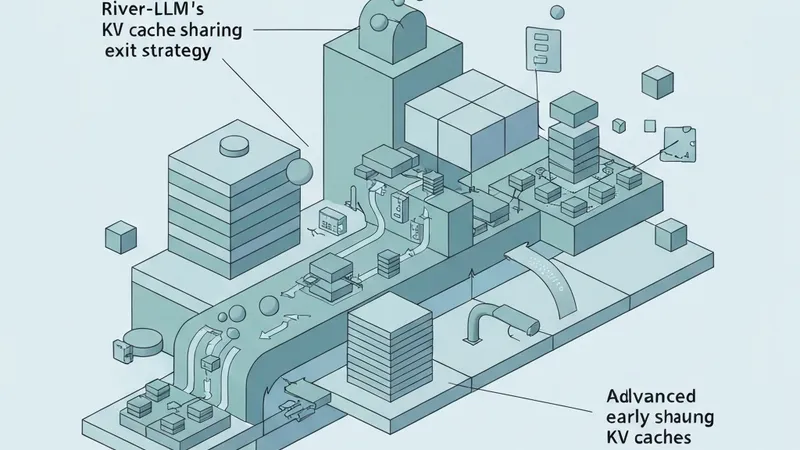

针对这一难题,研究人员提出了River-LLM,一个无需额外训练的框架,旨在实现无缝的token级别早期退出。River-LLM的核心是引入了一个轻量级的“KV共享退出河”(KV-Shared Exit River)机制。这一机制允许在退出过程中,自然地生成并保留主干网络中缺失的KV缓存,从而彻底消除了对昂贵恢复操作的需求。

此外,River-LLM还利用解码器块内部的状态转移相似性来预测累积的KV错误,并以此作为指导,做出精确的退出决策。在数学推理和代码生成任务上进行的广泛实验表明,River-LLM在保持高质量生成的同时,实现了1.71至2.16倍的实际推理速度提升。