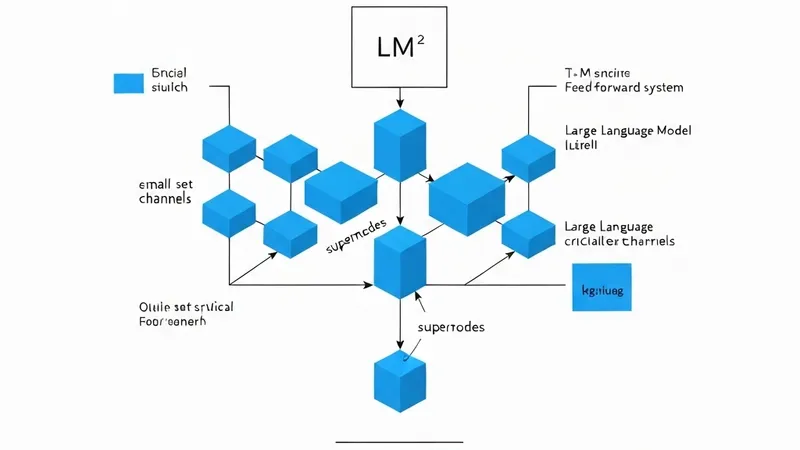

混合思考(hybrid-thinking)语言模型在明确区分“思考”和“不思考”模式时,常遭遇“推理泄露”问题。这意味着模型即使在“不思考”模式下也可能产生冗长且自我反思的响应,因为现有设计未能清晰分离这两种模式。通过数据整理和多阶段训练的现有解决方案效果有限,症结在于两种模式共享相同的全连接(feed-forward)参数。

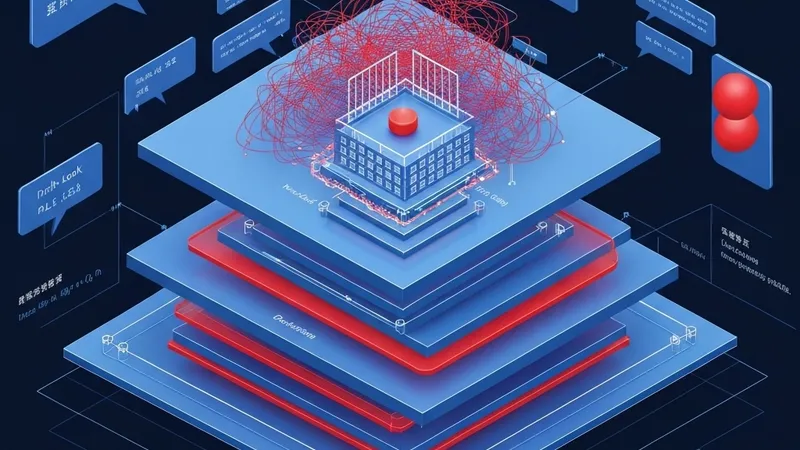

Path-Lock Expert (PLE) 提出了一种架构级解决方案。它在每个解码器层中,用两个语义上锁定的专家网络取代单一的多层感知机(MLP):一个专用于“思考”模式,另一个专用于“不思考”模式。关键在于,注意力机制、嵌入层、归一化层和语言模型头仍保持共享。一个确定性的控制令牌路由器会为整个序列选择一条专家路径,从而保留密集模型(dense model)的每令牌计算模式,并在监督微调期间使每个专家网络接收纯粹的模式特定更新。

PLE 在数学和科学推理基准测试中表现出色,它在保持强大“思考”模式性能的同时,显著提升了“不思考”模式:使其更准确、更简洁,并大大减少了推理泄露。例如,在 Qwen3-4B 模型上,PLE 将 AIME24 基准测试中“不思考”模式下的反射性令牌从 2.54 降低到 0.39,并将准确率从 20.67% 提高到 40.00%,同时不影响“思考”模式的性能。这些结果表明,可控的混合思考本质上是一个架构问题,通过分离模式特定的全连接通路提供了一种简单且有效的解决方案。