大型语言模型(LLM)智能体接收来自多种来源的指令,包括系统消息、用户提示、工具输出及其他智能体。这些指令各有其信任度和权限级别。当指令之间发生冲突时,智能体必须可靠地遵循最高权限的指令,以确保安全性和有效性。

目前主流的“指令层级(Instruction Hierarchy, IH)”范式假设指令权限只有固定且数量极少(通常少于五个)的层级,并通过僵硬的角色标签(例如:系统 > 用户)来定义。然而,这种方法对于真实的智能体应用场景来说是不足的,因为在这些场景中,冲突可能来自远多于此的源头和上下文。

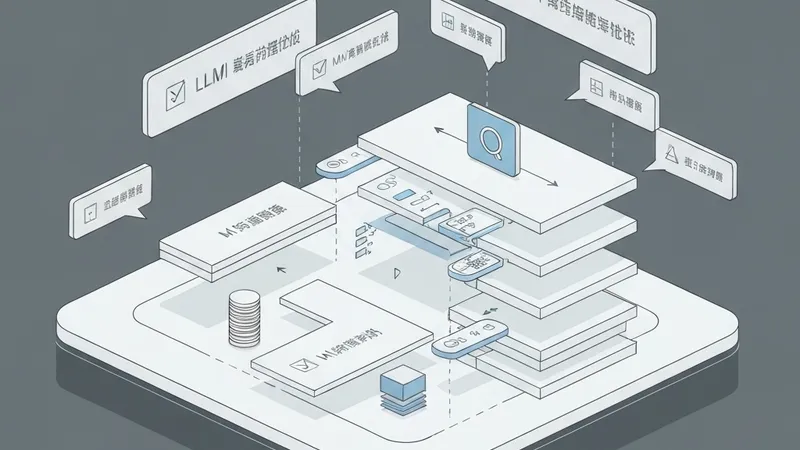

为解决这一问题,一项最新研究提出了一种名为“多层级指令层级(Many-Tier Instruction Hierarchy, ManyIH)”的新范式。ManyIH旨在解决具有任意多个权限层级的指令之间的冲突。

同时,该研究还引入了首个ManyIH基准测试工具——ManyIH-Bench。ManyIH-Bench要求模型在多达12个不同权限层级的冲突指令中进行导航,共包含853个智能体任务(其中427个为编码任务,426个为指令遵循任务)。

ManyIH-Bench通过结合LLM生成并由人类验证的约束条件,创建出跨越46个真实世界智能体的、既真实又极具挑战性的测试用例。实验结果表明,即使是当前的顶尖模型,在指令冲突规模增加时,表现也十分糟糕,准确率仅约为40%。

这项工作强调了在智能体环境中,迫切需要明确针对细粒度、可扩展指令冲突解决方案的方法。