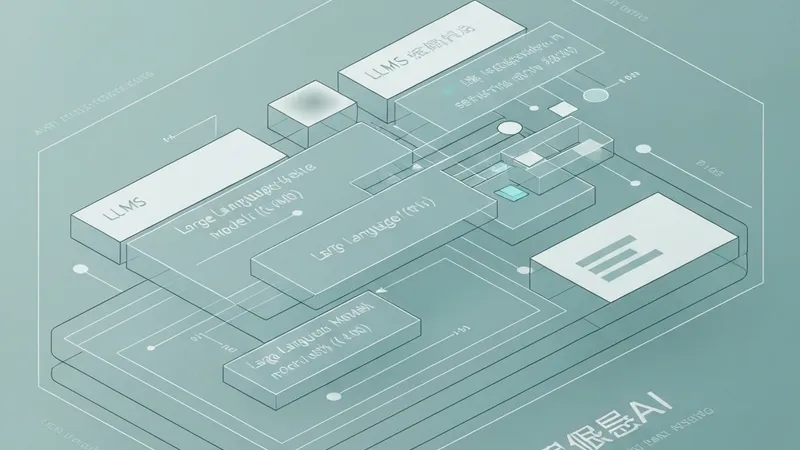

随着大语言模型(LLMs)被常规用于自主执行从自然语言处理到动态工作流(如网络搜索)的复杂任务,其功能性和面对滥用的脆弱性都在同步增长。特别是,工具调用(tool-calling)和检索增强生成(RAG)的应用,使得LLMs能够处理和检索敏感的企业数据,极大地提升了模型的应用范围,同时也放大了潜在的安全风险。

研究指出,随着LLMs与外部数据源的交互日益频繁,间接提示注入(indirect prompt injection)正成为一个关键且不断演变的攻击向量。这种攻击允许攻击者通过操纵输入,利用模型的弱点,进而实现数据窃取等恶意行为。为了深入理解这一威胁,研究人员对跨越不同模型的间接提示注入攻击进行了系统性评估,分析了当前LLMs对此类攻击的敏感程度。

评估着重探讨了影响模型漏洞的各项参数,包括模型规模、制造商以及具体的实现方式,并识别出最有效的攻击方法。研究结果令人担忧:即使是业界已知的攻击模式,至今仍能成功突破防线,暴露出模型防御中长期存在的弱点。

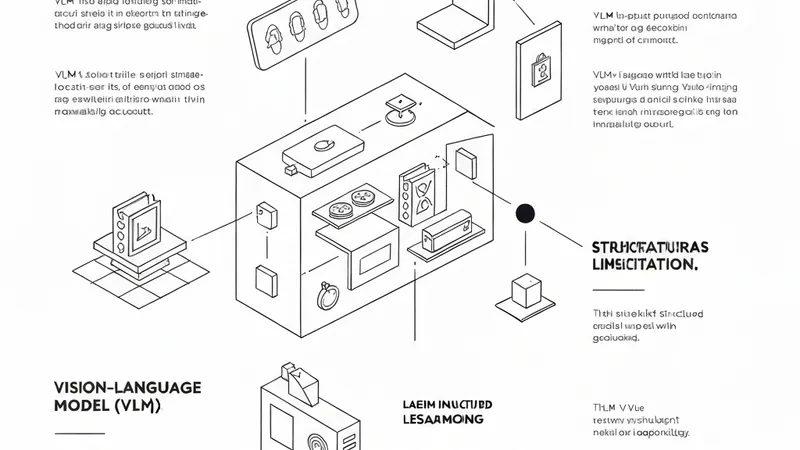

为应对这些脆弱性,研究强调了采取多方面措施的必要性:首先,需要强化模型训练程序,以提升LLMs固有的弹性;其次,应建立一个已知的攻击向量中心化数据库,从而实现更主动的防御;最后,推行统一的测试框架,以确保安全验证的持续性。这些步骤对于促使开发者将安全性融入LLM的核心设计至关重要,因为当前的研究发现表明,现有模型仍未能有效缓解这些长期存在的威胁。