多模态大语言模型(MLLMs)在视频时间定位(Video Temporal Grounding, VTG)方面取得了显著进展,但现有方法通常将输出范式与不同的骨干网络、数据集和训练协议耦合,使得难以单独评估输出设计对性能的具体影响。此外,随着VTG系统越来越多地考虑在资源受限的边缘设备上部署,系统层面的效率与输出形式之间的权衡需要被系统地研究。

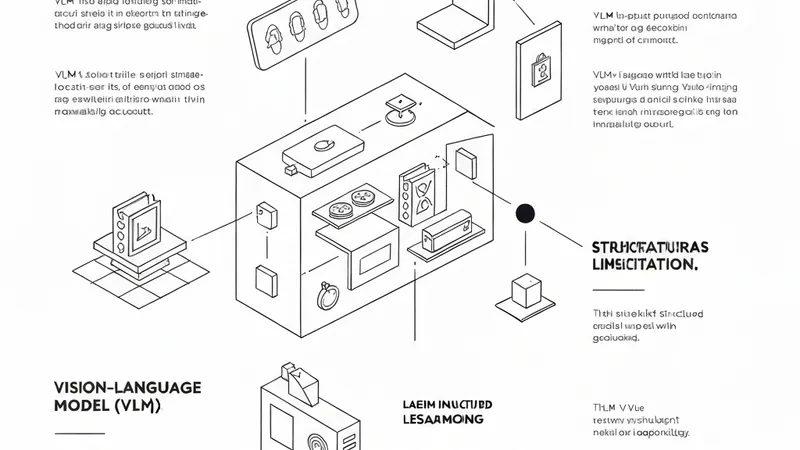

针对这些挑战,一项最新的受控实证研究对三种主流的VTG输出范式进行了比较:文本数字生成(Text Numeral Generation)、时间Token生成(Temporal Token Generation)和连续时间解码(Continuous Temporal Decoding)。研究团队在相同的紧凑型VLM(包括SmolVLM2、FastVLM和Molmo2)上,采用一致的数据集和LoRA微调协议对这些范式进行了评估。评估工作在Charades-STA、QVHighlights和YouCook2等数据集上进行,衡量指标涵盖了定位准确性以及系统效率,包括推理延迟、训练吞吐量和参数开销。

研究结果明确指出,无论模型规模大小,输出形式的选择都显著影响着定位准确性和计算成本。具体而言,连续分布范式(即连续时间解码)在Pareto前沿上始终保持着最优的效率-准确度权衡,实现了稳健的定位能力,同时最大限度地减少了延迟开销。这些发现为设计高效、可部署的VTG系统提供了客观的实证指导,对于推动AI在视频理解和边缘计算领域的应用具有重要意义。