谷歌的Gemini AI模型在过去一年中取得了巨大进步,但其使用受限于谷歌的专有条款。Gemma开源模型提供了更多自由,但一年前发布的Gemma 3已显老旧。从今天起,开发者可以使用Gemma 4,它提供四种针对本地使用优化的尺寸。谷歌也回应了开发者对AI许可的抱怨,因此放弃了自定义的Gemma许可证,转而采用Apache 2.0。

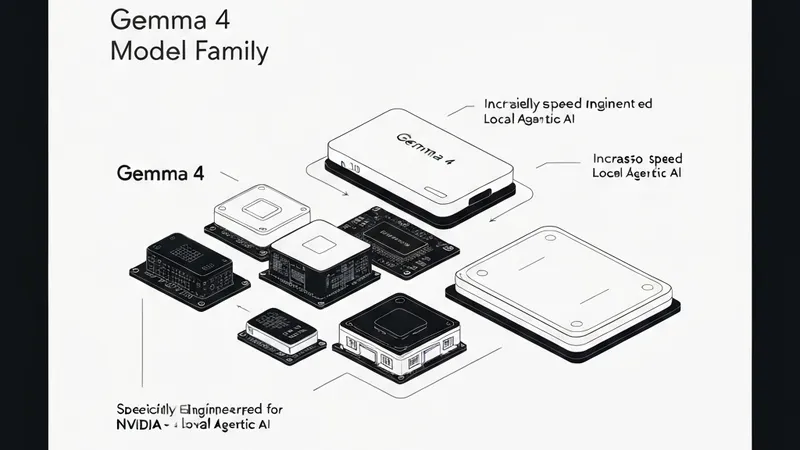

与之前的开源模型版本一样,谷歌将Gemma 4设计为可在本地机器上运行。这具体体现在:两个较大的Gemma变体——26B专家混合模型(Mixture of Experts)和31B密集模型(Dense)——被设计为在单块80GB Nvidia H100 GPU上以bfloat16格式非量化运行。尽管H100是一款价值2万美元的AI加速器,但这仍属于本地硬件范畴。如果量化到更低的精度,这些大型模型也可以在消费级GPU上运行。

谷歌还声称其专注于降低延迟,以充分利用Gemma的本地处理优势。其中,26B专家混合模型在推理模式下仅激活其260亿参数中的38亿,这使其令牌每秒处理量远高于同等规模的模型。而31B密集模型则更注重模型质量而非速度,谷歌预计开发者会对其进行微调以适应特定用途。

另外两个Gemma 4模型,有效2B(E2B)和有效4B(E4B),主要面向移动设备和边缘计算。这些选项旨在推理过程中保持低内存占用,实际运行参数分别为20亿或40亿。谷歌表示,Pixel团队与高通和联发科密切合作,优化了这些模型,使其能在智能手机、树莓派和Jetson Nano等设备上运行。与Gemma 3相比,它们不仅使用更少的内存和电池,谷歌还宣称实现了“接近零延迟”。

据透露,所有新的Gemma 4模型都将大幅超越Gemma 3。谷歌声称这是其在本地硬件上运行的最强大的模型。Gemma 31B有望在顶级开源AI模型的Arena排行榜上首次亮相,位列第三,仅次于GLM-5和Kimi 2.5。然而,即使是最大的Gemma 4变体,其尺寸也仅是这些领先模型的一小部分,理论上运行成本将大大降低。