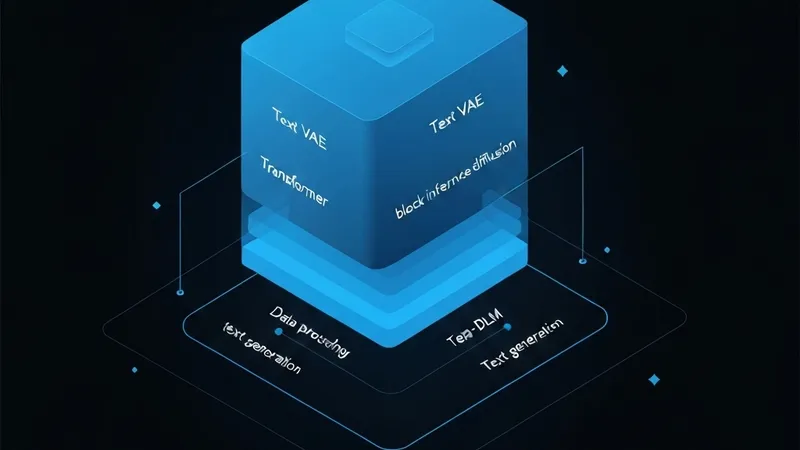

字节跳动近日发布了名为 Cola-DLM 的研究成果,这是一种连续潜在扩散语言模型(Continuous Latent Diffusion Language Models),旨在为生成式 AI 提供一种全新的架构范式。该模型的核心创新在于成功统一了文本变分自编码器(Text VAE)与块因果扩散 Transformer(block-causal Diffusion Transformer, DiT),将文本处理提升到了连续潜在序列的新高度。

在技术实现上,Cola-DLM 采用了先进的流匹配(Flow Matching)技术来进行潜在先验传输。这种方法允许模型在连续的潜在空间中进行高效的文本表征和生成,突破了传统离散 Token 生成的局限性。其架构设计充分考虑了可扩展性,能够适应大规模的预训练需求,为学术界和工业界探索非自回归生成模型提供了强有力的工具。

该研究详细介绍了一套严谨的两阶段训练方法论:首先进行 Text VAE 的预训练,以构建稳定的潜在表征空间;随后通过流匹配技术进行联合训练,优化潜在先验的分布。目前,字节跳动已将该框架完全开源,采用 Apache 2.0 协议,代码库基于 PyTorch 和 HuggingFace Transformers 构建,极大降低了研究人员复现和改进该技术的门槛。