当前AI系统在2D图像处理方面表现出色,能够瞬间识别街景中的物体、生成逼真的虚拟房间,甚至描述从未到过的地方。然而,这种能力大多停留在“平面世界”,仅基于2D网格上的像素进行推理,缺乏对这些像素所代表的3D物理世界的原生理解。

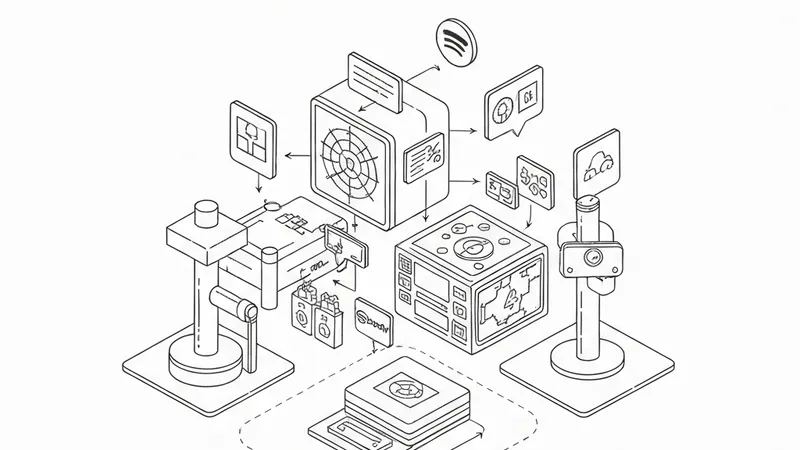

这种像素级智能与真实空间理解之间的巨大鸿沟,是阻碍AI走向物理世界应用的最大瓶颈。例如,需要在仓库中导航的机器人、规划障碍物路线的自动驾驶车辆,以及精确映射真实建筑的数字孪生系统,都迫切需要AI能够真正理解3D环境,而不仅仅是其2D投影。

令人振奋的是,目前有三个不同的AI技术层正在融合,使AI能够从普通照片中实现空间理解。其中一个关键但常被忽视的层面是“几何融合”。它能够将嘈杂的单图像预测转化为连贯的3D场景标签。在实际生产管线中,这项技术能带来显著的标签放大效应,将场景覆盖率从20%提升至78%,有效利用了大量的原始数据。

尽管从照片重建3D几何结构已是相对成熟的技术——例如,Structure-from-Motion管线在过去二十多年中一直用于匹配关键点并三角化3D位置;而像Depth-Anything-3这样的单目深度估计模型,现在也能从单一智能手机视频中生成密集的3D点云,无需专用硬件。但核心问题在于,如何为这些几何数据赋予“意义”。一个拥有80万个点但没有标签的点云,即使可视化效果再好,也无法回答“只显示墙壁”或“测量地板面积”等实际问题,因为它缺乏语义标签。

大规模生产这些语义标签的成本极其高昂。传统的做法依赖于激光雷达扫描仪和专业的标注团队,他们需要手动在特定软件中点击数百万个点。对一栋商业建筑的单层室内空间进行标注,一名熟练操作员通常需要八到十二小时。将这种成本放大到整个园区或一支扫描街道的车队,其经济性便难以维系。