当前,可解释人工智能(XAI)方法的评估正面临严峻挑战,核心问题在于缺乏标准化。现有评估指标的定义往往不一致,报告内容不完整,且很少能与通用基线进行有效验证。这种混乱局面严重阻碍了XAI研究的进展和可靠性。

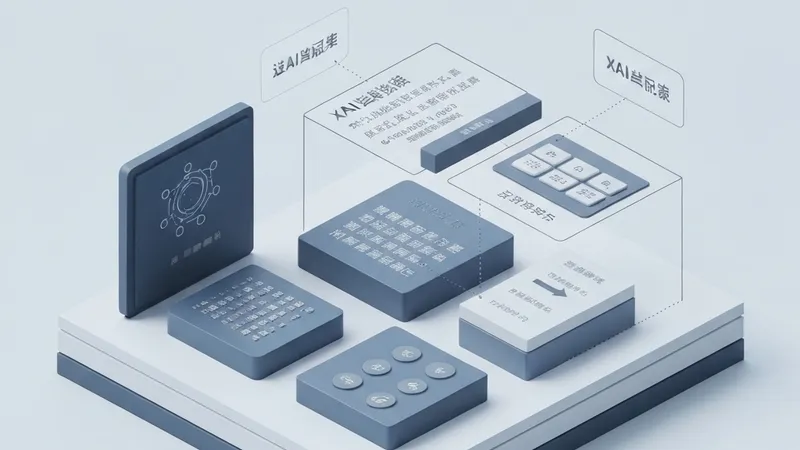

为解决这一痛点,研究人员指出,评估报告的透明度不足是一个长期被忽视的中心问题。为此,他们提出了一种创新解决方案——“XAI评估卡”。该卡片是一个文档模板,其设计理念类似于AI领域的“模型卡”,旨在作为任何引入XAI评估指标研究的配套文件。

“XAI评估卡”要求详细声明一系列关键信息,包括:目标属性(即指标旨在衡量什么)、基础级别(指标所依赖的底层概念)、指标假设、验证证据(如何证明指标的有效性)、潜在的“作弊”风险(即指标可能被恶意利用或误导的方式),以及已知的失效案例。研究者认为,如果将这一模板推广为社区规范,将有效减少评估碎片化,支持对XAI研究的元分析,并显著提升该领域的问责制和可信度。