在监督分类任务中,损失函数扮演着至关重要的角色,直接影响着机器学习模型的学习效率和最终性能。交叉熵(Cross-entropy, CE)作为最广泛应用的损失函数之一,而平均绝对误差(Mean Absolute Error, MAE)损失则以其出色的鲁棒性著称,尽管在优化上存在一定难度。

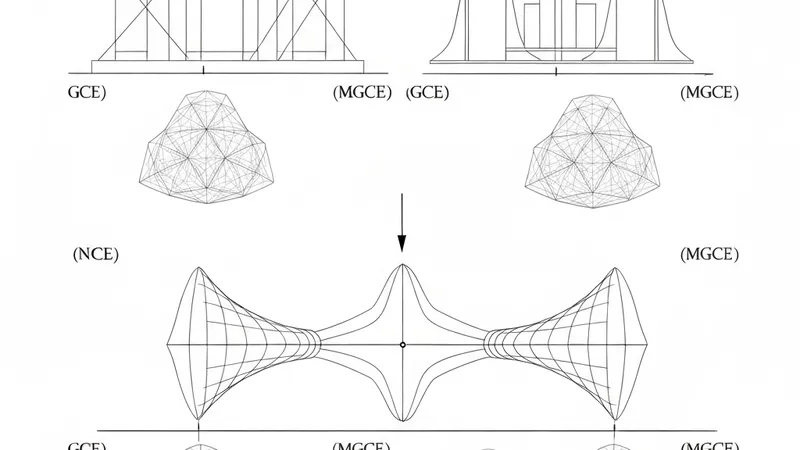

近年来,广义交叉熵(Generalized Cross-Entropy, GCE)被引入,旨在融合CE和MAE的优点,在优化难度与模型鲁棒性之间取得平衡。然而,现有GCE公式的优化问题通常是非凸的,特别是在分类边界方面,容易导致模型欠拟合,在处理复杂数据集时性能表现不佳。

针对这一挑战,最新研究提出了一种创新的极小极大广义交叉熵(Minimax Generalized Cross-Entropy, MGCE)公式。该方法的核心在于将分类边界的优化转化为一个凸优化问题,从而有效避免了非凸优化带来的局部最优和欠拟合风险。更值得关注的是,该研究证明了MGCE能够为分类误差提供一个可靠的上限。

研究团队进一步指出,所提出的双层凸优化(bilevel convex optimization)问题,可以通过隐式微分(implicit differentiation)计算随机梯度(stochastic gradient)来高效实现。在多个基准数据集上的实验结果表明,MGCE不仅在分类精度上取得了显著提升,还展现出更快的收敛速度和更好的模型校准性。尤其是在数据标签存在噪声的情况下,MGCE的优势更为突出,这对于构建鲁棒性更强的AI模型具有重要意义。