在不完全信息博弈(Imperfect-Information Games)中,例如扑克,玩家顺序行动且无法看到彼此的私有信息,为多智能体强化学习(MARL)设计算法一直以来都高度依赖人工迭代。研究人员往往通过直觉和反复试验来确定权重方案、折扣规则和均衡求解器。而谷歌DeepMind的研究人员提出了AlphaEvolve,一个由大语言模型(LLM)驱动的进化编码智能体,旨在用自动化搜索取代这种手动过程。

研究团队将这一框架应用于两个已建立的范式:反事实遗憾最小化(Counterfactual Regret Minimization, CFR)和策略空间响应预言机(Policy Space Response Oracles, PSRO)。在这两种情况下,AlphaEvolve系统都能发现新的算法变体,它们的表现与现有的人工设计SOTA(State-of-the-Art)基线算法竞争激烈,甚至超越了后者。所有实验均使用OpenSpiel框架运行。

背景:CFR和PSRO

CFR是一种迭代算法,通过信息集分解遗憾最小化。在每次迭代中,它会累积“反事实遗憾”——即玩家通过不同策略可能获得的收益——并根据正向累积遗憾推导出一个新的策略。经过多次迭代,时间平均策略会收敛到纳什均衡(Nash Equilibrium, NE)。像DCFR(Discounted CFR)和PCFR+(Predictive CFR+)这样的变体,通过应用特定的折扣或预测更新规则来改善收敛性,所有这些都是通过人工设计开发的。

PSRO在更高的抽象层次上运作。它为每个玩家维护一个策略种群,通过计算种群策略所有组合的期望效用构建一个收益张量(即元博弈),然后使用元策略求解器(meta-strategy solver)生成种群上的概率分布。最佳响应(Best Responses)会根据该分布进行训练并迭代地添加到种群中。元策略求解器——即如何计算种群分布——是该论文所针对的自动化发现的核心设计选择。所有实验都使用精确的最佳响应预言机(通过价值迭代计算)和所有元博弈条目的精确收益值,从而消除了蒙特卡洛采样噪声对结果的影响。

AlphaEvolve框架

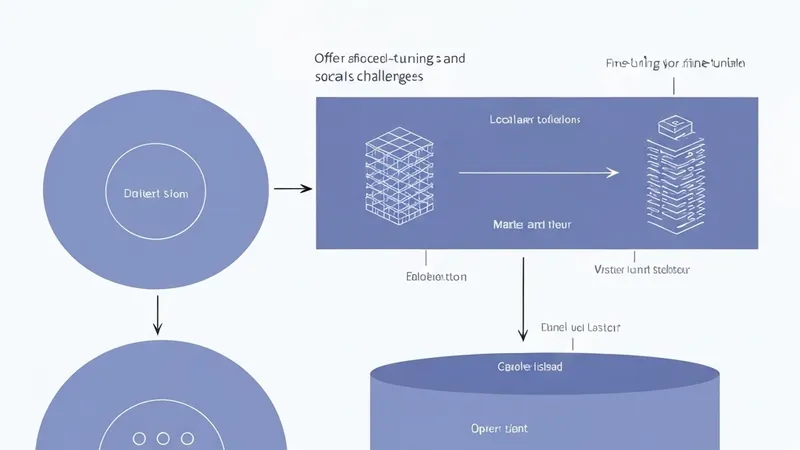

AlphaEvolve是一个分布式进化系统,它利用大语言模型(LLMs)来突变源代码,而非数值参数。其流程如下:首先,用一个标准实现初始化种群(CFR实验以CFR+为种子;两种PSRO求解器类均以Uniform为种子)。在每一代中,根据适应度选择一个父算法;其源代码会连同修改提示一起传递给LLM(Gemini 2.5 Pro);LLM生成候选算法;生成的候选算法在代理游戏中进行评估;有效的候选算法被添加到种群中。AlphaEvolve支持多目标优化——如果定义了多个适应度指标,则每代随机选择一个来指导父代采样。适应度信号为负可利用性(negative exploitability)。